深度学习系统容器化部署是将模型训练和推理流程封装到容器中,以提高环境一致性、简化部署过程。通过Docker等工具,可以将代码、依赖库和配置打包成一个镜像,确保在不同环境中运行时保持一致。

容器化后,深度学习服务可以通过Kubernetes等编排工具进行管理。Kubernetes能够自动处理容器的调度、扩展和故障恢复,提升系统的可靠性和可伸缩性。同时,它支持资源动态分配,避免计算资源浪费。

在优化实践中,需要关注容器镜像的大小和构建效率。使用多阶段构建减少最终镜像体积,同时利用缓存机制加快构建速度。•合理设置资源限制,避免单个容器占用过多CPU或内存。

网络和存储配置也是关键。深度学习任务通常涉及大量数据传输,需确保容器间通信高效,并结合持久化存储方案,保障模型和数据的安全性与可访问性。

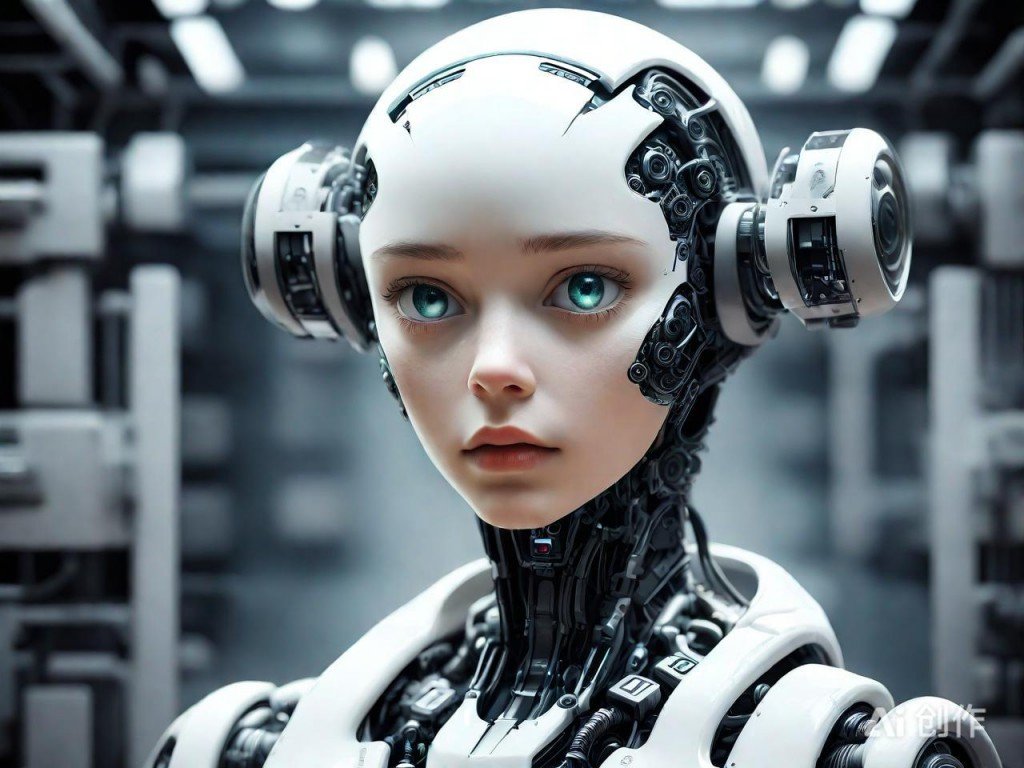

建议图AI生成,仅供参考

最终,通过监控和日志系统实时跟踪容器状态和性能表现,有助于及时发现并解决问题。结合自动化运维工具,可以进一步提升部署效率和系统稳定性。